CopyRight©2020-2030 www.poppur.com

各位在遇到新奇好玩的事情时总是乐于分享,不过来到VR体验这里似乎受到了阻碍——由于要保证VR沉浸感,现在的虚拟现实设备大都采用封闭式设计,结果就是玩家和外界基本是“各玩各的”,很难和身边的人有共鸣。为了让VR玩家看上去不会太智障,一般在体验PC VR时,旁边都会有显示屏同时播放游戏内容,而有些体验店还会用绿幕技术把你人也P进去,相当良心。

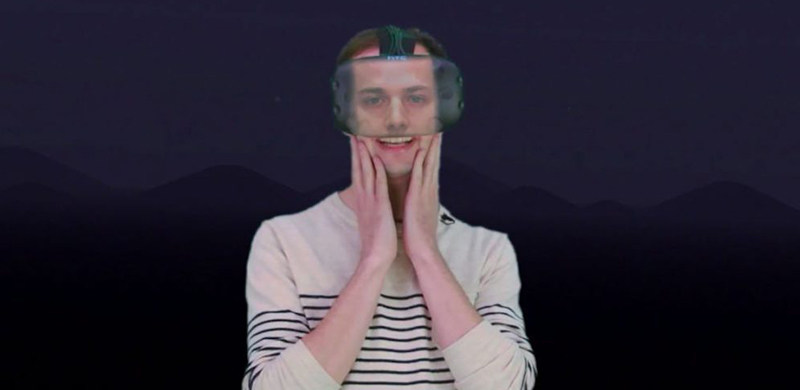

不过最关键的脸还是无可避免的被挡住了——这点很关键。有人曾经统计过,大家在和基友妹子看电视、看电影时,看到笑点时往往会更加注意身边朋友的反应,而不是电影本身的内容。举个不太适当的例子,就是你在旁观朋友用PSVR玩《生化危机7》,屏幕上面目狰狞的丧尸能比旁边瑟瑟发抖的画面有趣嘛?这时候看不到、拍不到基友的表情实在太遗憾!为了解决玩家在虚拟现实中的情感交流“障碍”,谷歌工程师(对,又是他们!)用混合现实技术把表情给“加”上去了。

如何给VR体验玩家在视频中添加真实表情?

既然VR头显暂时无法做透明,藏在眼镜后面的眼神怎么还原出来?谷歌工程师的是用人脸模型来来代替VR眼镜,实际技术过程很复杂,小编只能讲解几个简单的步骤:

模型收集与捕捉。既然要用人脸替代VR眼镜,那么收集人脸数据是必须的。首先工程师让玩家注视屏幕上一个移动的点,并且用动态采集系统将其各个角度注视的3D表情记录下来,为后期添加做准备;

定位与对齐。表情收集了,下一步就是怎么用表情自然地替代VR眼镜——这需要在3D坐标中完成定位,并用收集的表情去完美替换眼镜的位置。这里谷歌的主要是利用外部摄像头对头显进行校准与同步,并且将3D采集的表情整合到混合现实视频中(过程和算法还是很复杂的)。

图像合成与处理。当然光是找到位置还不够,要是表情不会随之变化,还不如打印个表情贴在眼镜上是吧......为了让收集的3D表情随着游戏动作而变化,谷歌在HTC Vive内部搭载了SMI眼动追踪.由于前面我们的表情就是根据注视点而收集的“数据库”,每一个点几乎都有对应着一个表情,这时候只需要追踪到玩家的眼睛注视点,并调用对应的表情就可以了。当然,后期还需要大量的颜色修正、平滑度调节等图像处理环节,才能得到这看上去还算OK的画面。

大家可能会有疑问,为什么在用表情替代了VR眼镜后,仍然会看到一个轮廓的效果?由于该效果只是在MR合成视频中近似还原,目前准确度和画面细节仍有待提升,经过工程师亲身体验后,逼真但又变形的程度容易让人作噩梦(恐怖谷效应)。为了避免这种情况,谷歌工程师特地加入了一个半透明面罩,既可以避免细节错误过于明显,同时在画面衔接上也更加舒服。

这项技术有谷歌Daydream Labs、Research和YouTube团队合作完成,在进行多人VR会议、VR聊天和VR游戏等场景,加入了人脸表情后显然看上去更加自然,以实现了刚开始“表情交流”的目的。不过这效果的确是有待提升......

上一篇:亲临深海世界和野外丛林,迪拜水族馆VR略显狂野!

下一篇:LINE现已加入360图片分享“全家桶”,微信什么时候才有?